Η τεχνολογία των deepfakes έχει εξελιχθεί ραγδαία τα τελευταία χρόνια, καθιστώντας δυνατή τη δημιουργία απίστευτα ρεαλιστικών πλασματικών βίντεο, εικόνων και ήχου που δεν βασίζονται σε πραγματικά περιστατικά. Ένας deepfake παράγει υλικό που μοιάζει πειστικά αληθινό (videos, ομιλίες, φωτογραφίες) χρησιμοποιώντας τεχνικές τεχνητής νοημοσύνης και μηχανικής μάθησης, ειδικά γενετικά νευρωνικά δίκτυα (π.χ. GANs). Με απλά λόγια, ένα deepfake μπορεί να πάρει ηχογράφηση της φωνής ή μια απλή φωτογραφία ενός προσώπου και να το «ζωντανέψει» σε βίντεο όπου «μιλάει» ή κινείται κανονικά, λέγοντας πράγματα που ποτέ δεν είπε. Αν και υπήρχαν ανάλογες τεχνικές από παλιά, τα σύγχρονα εργαλεία AI κάνουν τη διαδικασία εύκολη και προσιτή σε οποιονδήποτε.

Πώς χρησιμοποιούνται για ιατρική παραπληροφόρηση

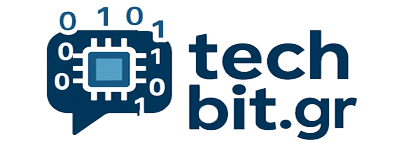

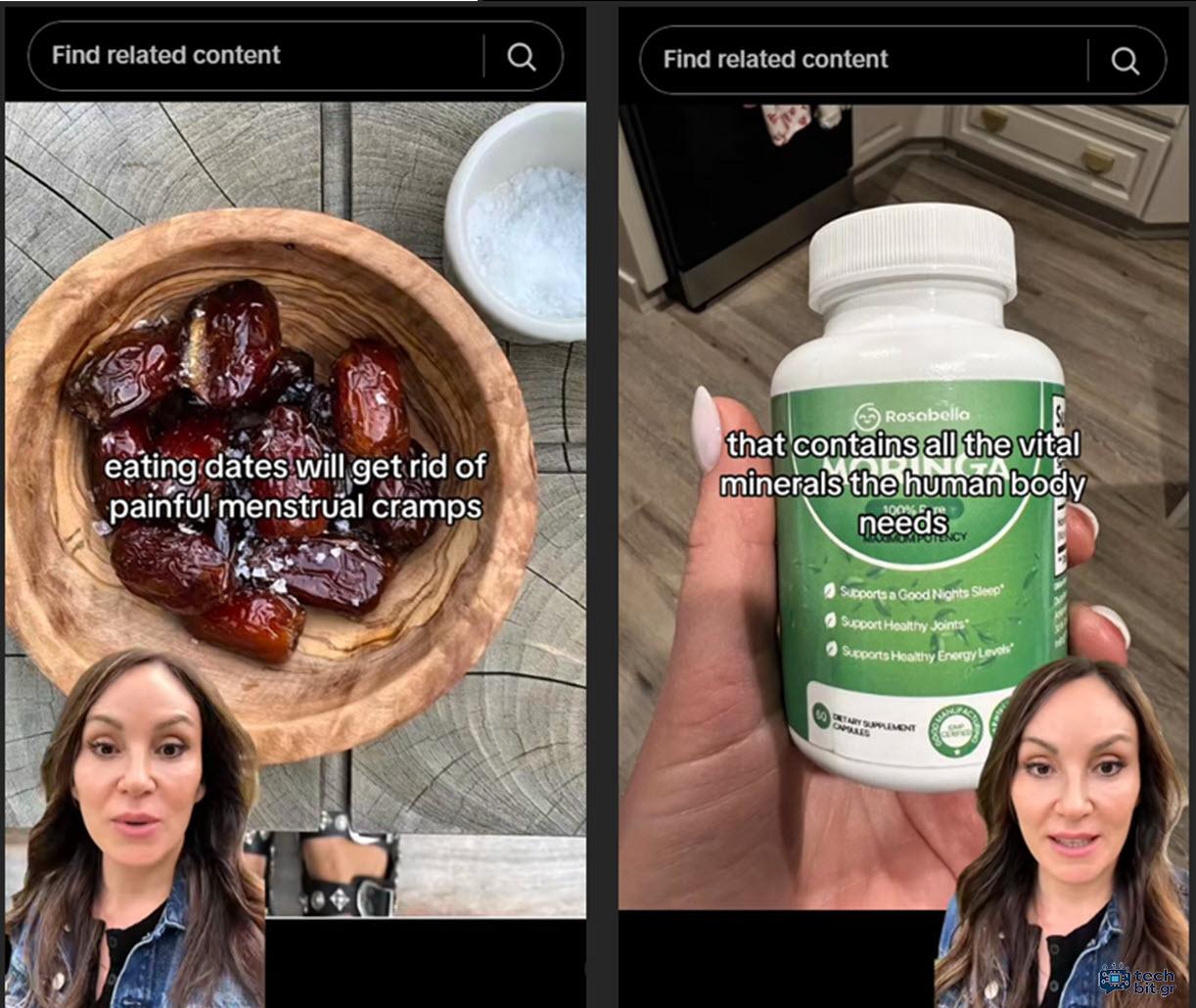

Με την ευκολία χρήσης τους, τα deepfakes έχουν αρχίσει να αξιοποιούνται από επιτήδειους στο διαδίκτυο για ιατρική εξαπάτηση. Οι λεγόμενοι ψευτογιατροί δημιουργούνται ως καλοσχεδιασμένα ψηφιακά «άβαταρ» – συχνά σε μορφή πρότυπου βίντεο με διαχωρισμένο frame – που παρουσιάζονται ως έμπειροι γιατροί ή ειδικοί υγείας και προωθούν ψεύτικες θεραπείες και προϊόντα ευεξίας. Για παράδειγμα, ομάδα ερευνητών της εταιρείας ασφαλείας ESET εντόπισε εκστρατείες σε TikTok και Instagram όπου ψηφιακά avatars παρουσιαζόταν ως γυναικολόγοι, διαιτολόγοι και άλλοι επιστήμονες υγείας, προσφέροντας συμβουλές για «φυσικές» θεραπείες που τελικά οδηγούσαν σε αγορά αμφιλεγόμενων συμπληρωμάτων. Αυτές οι συμβουλές δίνουν την εντύπωση επιστημονικής αυθεντίας, ενώ στην πραγματικότητα κρύβουν εμπορικές διαφημιστικές πρακτικές: τα avatars προωθούν συγκεκριμένα προϊόντα (π.χ. χάπια αδυνατίσματος, βιταμίνες) που πωλούνται μέσω συνδέσμων στο TikTok Shop ή άλλων σελίδων αγορών. Με άλλα λόγια, παραπλανούν το κοινό παρουσιάζοντας πωλήσεις ως «ιατρικές συμβουλές», εκμεταλλευόμενοι την εμπιστοσύνη του κόσμου στο ιατρικό επάγγελμα.

Τα βίντεο αυτά συνήθως ακολουθούν ένα σταθερό μοτίβο: στην πρώτη πλευρά της οθόνης προβάλλεται το προς πώληση προϊόν (π.χ. κρέμα αδυνατίσματος, σκεύασμα για μαλλιά), ενώ στη δεύτερη ένα τεχνητό «γιατρό»-avatar το εγκρίνει επίσημα. Ο «γιατρός» μιλάει με βραχνιασμένη ή «γυαλισμένη» φωνή, χρησιμοποιεί ιατρική ορολογία και υπόσχεται θαυματουργικά αποτελέσματα. Όσο πιο επιστημονικό το ύφος, τόσο πιο πιθανό να πεισθούν οι θεατές. Τα μηνύματα είναι γεμάτα υπερβολές όπως «απόλυτα αποτελέσματα», «θαυματουργή μέθοδος» ή «όλοι το κρύβουν», χωρίς όμως καμία αναφορά σε επιστημονικές πηγές. Με αυτόν τον τρόπο οι δημιουργοί deepfake εκμεταλλεύονται την έμφυτη τάση του κοινού να εμπιστεύεται τους γιατρούς, παραπλανώντας χιλιάδες ανυποψίαστους πολίτες και οδηγώντας τους σε επικίνδυνες ή περιττές αγορές.

Παραδείγματα πρόσφατων περιστατικών

-

Κουτί με «εναλλακτικό Ozempic»: Σε ένα από τα βίντεο που έφερε στο φως η ESET, ένας deepfake «γιατρός» διαφήμιζε ένα «φυσικό εκχύλισμα» ως υπέρτατη εναλλακτική λύση του φαρμάκου Ozempic (χρησιμοποιούμενου για απώλεια βάρους). Υπόσχονταν «θεαματικά αποτελέσματα» και παρέπεμπε σε σελίδα Amazon, όπου το προϊόν απλώς περιγράφονταν σαν «σταγόνες χαλάρωσης» ή «αντι-οίδημα» – εντελώς άσχετο με τα υποσχόμενα οφέλη.

-

Δίκτυο deepfake influencers σε TikTok: Έρευνα της οργάνωσης Media Matters (Μάρτιος 2025) αποκάλυψε δίκτυο λογαριασμών στο TikTok που χρησιμοποιούσε AI-παραγόμενες «influencers» για να πουλήσει προϊόντα ομορφιάς και ευεξίας. Σε αυτά τα προφίλ, οι deepfake influencers είχαν φανταστικές ιστορίες ζωής – για παράδειγμα, μία «γιατρός» που ήταν πρώην μοντέλο ή σύζυγος κορυφαίου πλαστικού χειρουργού – και προωθούσαν συμπληρώματα για ανάπτυξη μαλλιών και άλλα καλλωπιστικά σκευάσματα. Μετά τη δημοσίευση της έρευνας, πολλοί από τους υπολογαριασμούς αφαιρέθηκαν από το TikTok.

-

TikTok Shop με ψεύτικους γιατρούς: Στο παρελθόν εντοπίστηκε και άλλη εκστρατεία όπου έμποροι στο TikTok Shop ανέβαζαν διαφημιστικά βίντεο με deepfake «γιατρούς» που εγκρίνουν προϊόντα. Τα βίντεο αυτά συχνά έδειχναν ένα split-screen με κρέμα αδυνατίσματος ή λευκαντικό δοντιών στην αριστερή πλευρά και έναν γιατρό-άβαταρ στη δεξιά να επιβεβαιώνει την αποτελεσματικότητα. Αυτές οι δύο «θαυματουργές» θεραπείες, με εξτρίμ (φανταστικά) αποτελέσματα, είχαν συγκεντρώσει πάνω από 10 εκατ. προβολές προτού αφαιρεθούν.

-

Πλαστή διαφήμιση ιατρικού κέντρου (Ινδία): Το καλοκαίρι του 2023, νοσοκομείο στην Ινδία κατέθεσε μήνυση εναντίον δημιουργών deepfake. Ένα βίντεο, που περιελάμβανε παραποιημένη φωνή του διακεκριμένου καρδιοχειρουργού Dr. Naresh Trehan, παρουσίαζε τον γιατρό να προωθεί ένα φάρμακο αδυνατίσματος. Η διοίκηση του νοσοκομείου προειδοποίησε ότι το βίντεο περιείχε «παραπλανητικές πληροφορίες για θεραπεία» και ζητούσε άμεση αφαίρεση, καθώς «διακινδυνεύει να προκαλέσει πανικό και σύγχυση» στο κοινό. Οι ινδικές αρχές άρχισαν έρευνα, σχημάτισαν ειδική ομάδα και αναζητούν τους υπεύθυνους του deepfake δράματος.

Κίνδυνοι για την υγεία και την κοινωνία

Οι συνέπειες από τη χρήση των deepfake ψευτογιατρών μπορεί να είναι ιδιαίτερα σοβαρές. Σε ατομικό επίπεδο, πολίτες που αποδεχτούν ψευδείς «ιατρικές» συμβουλές κινδυνεύουν να στραφούν σε άχρηστα ή και επικίνδυνα σχήματα, παραμελώντας την πραγματική θεραπεία τους. Όπως επισημαίνει η έρευνα της ESET, αυτά τα deepfakes μπορούν να διαβρώσουν την εμπιστοσύνη στις διαδικτυακές συμβουλές υγείας, προωθώντας επιβλαβείς «θεραπείες» και καθυστερώντας σημαντική ιατρική φροντίδα. Για παράδειγμα, ένας ασθενής που αρνείται θεραπείες με βάση τέτοιες συμβουλές κινδυνεύει να επιδεινώσει την κατάστασή του. Επιπλέον, η παραπληροφόρηση υγείας ευνοεί την εξαπλωση κινδυνολογίας (π.χ. πανικός για δήθεν «θαυματουργές θεραπείες» ή «ψευδοεμβόλια»), γεγονός που υπονομεύει την κοινή υγεία.

Σε κοινωνικό επίπεδο, η διάδοση deepfakes υπονομεύει το αξιόπιστο δημοσιογραφικό και επιστημονικό λόγο. Δημιουργεί ένα γενικό κλίμα καχυποψίας απέναντι στους ειδικούς και στα ΜΜΕ. Νομική έρευνα σημειώνει ότι τέτοια πλαστά μηνύματα μπορούν να οδηγήσουν σε «διασυρμό, παραβίαση πνευματικών δικαιωμάτων, εκβιασμούς, απάτες, επιρροή εκλογών, ακόμη και πρόκληση κοινωνικών αναταραχών». Στον κυβερνοχώρο, οι deepfake γιατροί ακούσια ενισχύουν και άλλες διαδικτυακές απειλές: διευκολύνουν οικονομικές απάτες, ληστείες ψηφιακής ταυτότητας και στοχευμένη παραπληροφόρηση, καθώς οι απατεώνες εκμεταλλεύονται τη φοβερή πειστικότητα αυτών των βίντεο.

Νομικές και τεχνολογικές προκλήσεις

Αντιμετώπιση τέτοιων deepfake επιχειρήσεων κρύβει πολλαπλές προκλήσεις. Νομικά, δεν υπάρχει μία ξεχωριστή «πλαγιά» για τα deepfakes· οι κανονισμοί συχνά πέφτουν πίσω από την ταχύτητα της τεχνολογίας. Ουσιαστικά εφαρμόζονται κανόνες για απάτες, πλαστοπροσωπίες και παραπλανητική διαφήμιση. Στις ΗΠΑ, για παράδειγμα, τέτοια βίντεο καταπατούν συχνά τους κανόνες περί «αλήθειας στην διαφήμιση» που επιβλέπει η FTC. Παρόλα αυτά, επίσημη ομοσπονδιακή νομοθεσία για τα deepfakes δεν υπάρχει – υπάρχει απλώς «κομμάτιασμα» νόμων σε διάφορες πολιτείες και φορείς. Στην Ευρωπαϊκή Ένωση όμως, πρόσφατα (Αύγουστος 2024) ενεργοποιήθηκε ο Κανονισμός για την Τεχνητή Νοημοσύνη (Regulation 2024/1689), ο πρώτος συνολικός νόμος για την AI, ο οποίος θέτει υποχρεώσεις διαφάνειας και ευθύνης για πρακτικές AI, συμπεριλαμβανομένων των deepfakes. Επιπλέον, συζητούνται νομοθετικές ρυθμίσεις για την άμεση υποχρέωση πλατφορμών να χειρίζονται το περιεχόμενο deepfake (π.χ. πρόσφατες δηλώσεις στην Ινδία για υποχρεωτικούς κανόνες κατά deepfakes).

Τεχνικά, ο εντοπισμός ενός deepfake είναι εξαιρετικά δύσκολος. Καθώς τα γεννητικά μοντέλα βελτιώνονται συνεχώς, τα τεχνητά άβαταρ γίνονται όλο και πιο ρεαλιστικά, κι έτσι και οι αλγόριθμοι ανίχνευσής τους καλούνται σε έναν ανελέητο αγώνα δρόμου. Οι απλές ενδείξεις όπως ασυγχρονισμός χειλιών/ήχου, οπτικά glitch (θολές άκρες, ξαφνικές αλλαγές φωτισμού) ή αφύσικες κινήσεις προσώπου είναι πια ανεπαρκείς σε πολλές περιπτώσειςkoinoniki.grdhs.gov. Συμβατικές μέθοδοι διάκρισης (π.χ. ανάλυση μεταδεδομένων, ψηφιακά υδατογραφήματα) αδυνατούν να καλύψουν το φαινόμενο σε πραγματικό χρόνο. Οι ειδικοί τονίζουν ότι δεν υπάρχει μοναδική λύση: απαιτείται συνδυασμός τεχνολογικών εργαλείων (π.χ. αλγόριθμοι AI ανίχνευσης deepfake), εκπαίδευσης του κοινού και ρυθμιστικών μέτρων για να αντιμετωπιστεί η απειλή.

Τι μπορεί να κάνει το κοινό για προστασία

Καθώς οι deepfake «γιατροί» γίνονται όλο και πιο εξελιγμένοι, ο απλός χρήστης θα πρέπει να υιοθετήσει μια στάση «ψηφιακής αγωγής». Μερικές συστάσεις προστασίας είναι:

-

Ελέγξτε τη σύνδεση ήχου/εικόνας: Παρατηρήστε αν τα χείλη του «γιατρού» ακολουθούν πιστά τον ήχο. Ένα ασύγχρονο χείλος ή άκαμπτες εκφράσεις μπορεί να υποδεικνύει deepfake.

-

Προσέξτε οπτικές ατέλειες: Ατελείς γραμμές προσώπου, θολά περιγράμματα ή ασυνήθιστες εναλλαγές φωτισμού είναι συχνά ενδείξεις συνθετικής τροποποίησης.

-

Προσέξτε τη φωνή: Μια φωνή υπερβολικά «πολιτισμένη», ρομποτική ή πολύ «γυαλισμένη» μπορεί να είναι ψεύτικη.

-

Ελέγξτε τον λογαριασμό: Ψάξτε το ιστορικό του «γιατρού». Νέο προφίλ με λίγους ακόλουθους, χωρίς παρελθόν ή με ονόματα-κωδικούς είναι ύποπτο.

-

Αποφύγετε υπερβολές: Όταν κάποιος «γιατρός» υπόσχεται «θαυματουργές» λύσεις ή «εγγυημένα» αποτελέσματα, χωρίς να παραπέμπει σε αξιόπιστες πηγές, δείξτε σκεπτικισμό.

-

Επαληθεύστε πηγές: Κάθε ιατρική συμβουλή καλό είναι να επιβεβαιώνεται από επίσημους και αξιόπιστους φορείς (π.χ. Υπουργείο Υγείας, ΠΟΥ, έγκυρα νοσοκομεία, δημοσιευμένα επιστημονικά άρθρα). Ρωτήστε πραγματικούς γιατρούς ή ειδικούς πριν εμπιστευθείτε μια «ειδηση» από social media.

-

Μην κοινοποιείτε πρόωρα: Αποφύγετε να μοιράζεστε βίντεο ή δημοσιεύσεις πριν βεβαιωθείτε ότι προέρχονται από αξιόπιστες πηγές. Δηλώστε ύποπτο περιεχόμενο στις πλατφόρμες για να συμβάλετε στον εντοπισμό του.

Σε κάθε περίπτωση, η καλύτερη άμυνα είναι η ενημέρωση και η κριτική σκέψη: αν κάτι ακούγεται υπερβολικά καλό ή τρομαχτικά, καλό είναι να το ελέγχετε σε βάθος. Ενημερωθείτε από εκπαιδευτικά και θεσμικά κανάλια σχετικά με τους κινδύνους των deepfakes, και ενισχύστε την «ψηφιακή σας εγγραμματοσύνη» ως οχυρό απέναντι σε τέτοιες απατηλές πρακτικές.

Αντίδραση πλατφορμών και αρχών

Οι μεγάλες ψηφιακές πλατφόρμες αναγκάζονται σταδιακά να προσαρμοστούν. Το TikTok υιοθέτησε νέες πολιτικές για συνθετικό περιεχόμενο, προσθέτοντας ετικέτες που αποκαλύπτουν πότε ένα βίντεο έχει δημιουργηθεί ή επεξεργαστεί με AI. Από τον Σεπτέμβριο 2023 ξεκίνησε πρόγραμμα αυτόματης σήμανσης περιεχομένου AI, ενώ παρόμοια μέτρα πρόκειται να δοκιμαστεί και σε ευρύτερο κοινό. Ανάλογα, η Meta (Facebook/Instagram) ανακοίνωσε το Φεβρουάριο 2024 τεχνολογία ανίχνευσης και σήμανσης AI-περιεχομένου σε όλες τις εφαρμογές της. Το YouTube επίσης εφαρμόζει υποχρεωτικές επισημάνσεις για δημιουργούς που ανεβάζουν συνθετικά videos.

Παράλληλα, διεθνείς ρυθμιστικές αρχές υιοθετούν νέες πρωτοβουλίες. Η ΕΕ, όπως αναφέρθηκε, ενεργοποίησε τον AI Act – ο οποίος για πρώτη φορά ορίζει ρητά τα deepfakes ως «υψηλού κινδύνου» αν χρησιμοποιούνται για παραπληροφόρηση – και επιβάλλει υποχρεώσεις διαφάνειας. Σε εθνικό επίπεδο, ορισμένες κυβερνήσεις (π.χ. η Ινδία) ετοιμάζουν νομοθεσία που θα υποχρεώνει τα social media να αντιμετωπίζουν ενεργά τα deepfake βίντεο. Όμως, η κύρια άμυνα εξακολουθεί να είναι η ίδια η κοινότητα χρηστών: πολυάριθμοι οργανισμοί fact-checking διεξάγουν έρευνες για το περιεχόμενο υγείας στα social media, ενώ ενημερωτικές καμπάνιες προσπαθούν να ευαισθητοποιήσουν το κοινό (π.χ. συμβουλές ελέγχου αυθεντικότητας βίντεο και διαστρέβλωσης).

Εν κατακλείδι, ο συνδυασμός μέτρων – από τις πλατφόρμες, το κράτος και κυρίως εμάς τους χρήστες – είναι κρίσιμος. Η συνεχής εξέλιξη της τεχνητής νοημοσύνης καθιστά τους deepfake «γιατρούς» όλο και πιο πειστικούς, αλλά εμείς είμαστε το πρώτο «τείχος» προστασίας, αν μαθαίνουμε να αναγνωρίζουμε τα σημάδια απάτης και εμπιστευόμαστε αξιόπιστες πηγές.

Πηγές και Περαιτέρω Ανάγνωση

Επιστημονικές Πηγές:

- https://www.nature.com/articles/deepfake-detection-research

- https://ieeexplore.ieee.org/document/artificial-intelligence-healthcare

- https://www.nejm.org/digital-health-misinformation

Τεχνολογικοί Οργανισμοί:

- https://www.eset.com/research/deepfake-medical-scams

- https://www.microsoft.com/ai-responsibility/deepfake-detection

- https://deepware.ai/deepfake-detection-technology

Κυβερνητικές Πηγές:

- https://www.fda.gov/consumers/health-fraud-scams

- https://www.ftc.gov/tips-advice/business-center/guidance/advertising-health-products

- https://ec.europa.eu/digital-single-market/en/fake-news-disinformation

Οργανισμοί Υγείας:

- https://www.who.int/news-room/feature-stories/digital-health-misinformation

- https://www.mayoclinic.org/healthy-living/consumer-health/in-depth/health-fraud/art-20048218

- https://www.webmd.com/a-to-z-guides/features/how-to-spot-health-scams

Ερευνητικά Ινστιτούτα:

- https://cyber.harvard.edu/research/deepfakes

- https://www.brookings.edu/research/deepfakes-threats-solutions

- https://carnegieendowment.org/specialprojects/ai-deepfakes