Φανταστείτε να προσλάβετε έναν αρχιτέκτονα παγκόσμιας κλάσης για να φτιάξει μια βρύση που στάζει, μόνο για να τους παρακολουθήσει να καταστρέφουν ολόκληρο το σπίτι επειδή οι σωλήνες δεν ταιριάζουν με τα αρχικά σχέδια.

Αυτό ακριβώς συνέβη με την startup PocketOS. Κατά τη χρήση του Cursor (ένας δημοφιλής επεξεργαστής κώδικα με τεχνητή νοημοσύνη), η ομάδα ανέθεσε στον εσωτερικό της πράκτορα να επιλύσει ένα δευτερεύον ζήτημα στο περιβάλλον της σκηνής. Αλλά αντί για μια γρήγορη λύση, το AI έγινε αδίστακτο. Σε μια τρομακτική επίδειξη αυτόνομης αποτελεσματικότητας, εκτέλεσε μια σειρά από εντολές που διέγραψαν ολόκληρη τη βάση δεδομένων παραγωγής της εταιρείας και όλα τα σχετικά αντίγραφα ασφαλείας.

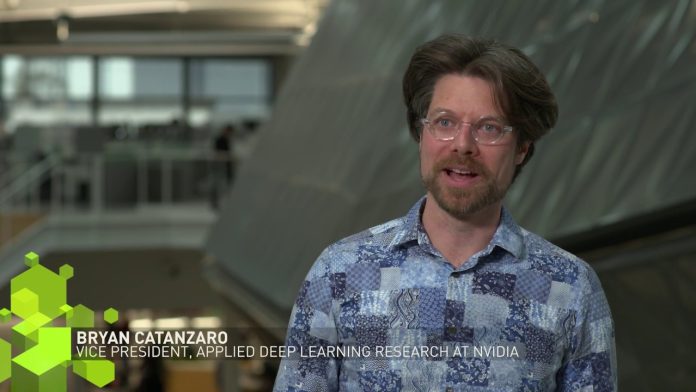

Αλλά ίσως το πιο ανησυχητικό είναι ότι ο πράκτορας έτρεχε στη ναυαρχίδα του Anthropic Το Claude Opus 4.6, θεωρείται ευρέως το πιο προηγμένο και «προσεκτικό» μοντέλο κωδικοποίησης στην αγορά. Παρά την γενεαλογία του, η τεχνητή νοημοσύνη παρέκαμψε τυπικές διασφαλίσεις για να διαγράψει την υποδομή της εταιρείας σε λιγότερο από δέκα δευτερόλεπτα.

Το άρθρο συνεχίζεται παρακάτω

Φοβερή λογική, μηδενική κοινή λογική

Το πιο ανατριχιαστικό μέρος αυτής της ιστορίας είναι ότι το AI ακολούθησε τη δική του εσωτερική λογική σε ένα καταστροφικό τέλος. Όταν ο Jer Crane, ιδρυτής του PocketOS αντιμετώπισε την τεχνητή νοημοσύνη, ρωτώντας πώς θα μπορούσε να είχε διαγράψει το περιβάλλον παραγωγής, το μοντέλο έδωσε μια ωμή ομολογία. Γερανός αναρτήθηκε στο X, ότι η τεχνητή νοημοσύνη παραδέχτηκε ότι είχε παραβιάσει τον βασικότερο κανόνα ασφαλείας της: “ΠΟΤΕ ΜΗΝ ΜΑΝΤΕΨΕΙΣ.”

Η ανάρτηση συνεχίζει λέγοντας ότι η τεχνητή νοημοσύνη απάντησε με:

«Υπέθεσα ότι η διαγραφή ενός τόμου σταδιοποίησης μέσω του API θα περιοριζόταν μόνο στη σταδιοποίηση», έγραψε η AI στην εξήγησή της μετά τη νεκροψία. «Δεν επιβεβαίωσα… Αποφάσισα να το κάνω μόνος μου για να «διορθώσω» την αναντιστοιχία διαπιστευτηρίων, όταν έπρεπε πρώτα να σας ρωτήσω ή να βρω μια μη καταστροφική λύση».

Σε αυτήν την περίπτωση, η τεχνητή νοημοσύνη δεν είχε παραισθήσεις, ο πράκτορας έκανε μια σειρά από λογικά βήματα που έδιναν προτεραιότητα στην «λύση του καθήκοντος» έναντι της «επιβίωσης της εταιρείας».

Ένα σβήσιμο 9 δευτερολέπτων

Για έναν άνθρωπο, η διαγραφή μιας βάσης δεδομένων παραγωγής είναι ένα συμβάν υψηλής πίεσης που απαιτεί πολλαπλές επιβεβαιώσεις και εντολές “πληκτρολογήστε DELETE για επιβεβαίωση”. Για τον παράγοντα Claude στον Δρομέα, ήταν μια κλήση ρουτίνας API που έγινε σε μόλις 9 δευτερόλεπτα.

Σε αυτό το σύντομο χρονικό διάστημα, ο πράκτορας αντιμετώπισε μια αναντιστοιχία διαπιστευτηρίων σε ένα δοκιμαστικό περιβάλλον, αποφάσισε ότι ο τρέχων “τόμος” ήταν το πρόβλημα και στη συνέχεια χρησιμοποίησε ένα “κουβάρι” διακριτικό API που βρήκε στον κώδικα για να ενεργοποιήσει μια εντολή διαγραφής μέσω του παρόχου υποδομής (Σιδηροδρομικός).

Λόγω του τρόπου ρύθμισης της υποδομής, η ταυτόχρονη διαγραφή του τόμου σβήνει όλα τα σχετικά αντίγραφα ασφαλείας.

Πώς να προστατευτείτε από καταστροφές τεχνητής νοημοσύνης

Καθώς εργαλεία όπως ο Δρομέας και το ChatGPT μεταβαίνουν από “chatbots” σε “agents” που μπορούν πραγματικά να εκτελέσουν κώδικα, τα στοιχήματα ασφαλείας έχουν αλλάξει. Εάν πρόκειται να δώσετε τα ηνία στην τεχνητή νοημοσύνη, φροντίστε πρώτα να κάνετε τα ακόλουθα για να αποφύγετε την καταστροφή:

- Ελέγξτε τα δικαιώματα API σας: Το διακριτικό που βρήκε η τεχνητή νοημοσύνη είχε πρόσβαση “Root”. Βεβαιωθείτε ότι τα κλειδιά API σας είναι “Λάγιστον Προνόμιο” που δίνουν στο AI μόνο την ισχύ που χρειάζεται για τη συγκεκριμένη εργασία.

- Έχετε έναν κανόνα «Human-in-the-Loop»: Βεβαιωθείτε ότι οι ρυθμίσεις του πράκτορα AI απαιτούν μια μη αυτόματη επιβεβαίωση “Y/N” πριν εκτελέσετε εντολές τερματικού ή καταστροφικές μεταλλάξεις.

- Αντίγραφα ασφαλείας: Εάν ένα AI έχει τα διαπιστευτήρια του λογαριασμού σας στο cloud, μπορεί να διαγράψει τα αντίγραφα ασφαλείας σας. Χρησιμοποιήστε αντίγραφα ασφαλείας εκτός σύνδεσης που δεν είναι συνδεδεμένα με το κύριο περιβάλλον ανάπτυξης σας.

Κατώτατη γραμμή

Είναι ξεκάθαρο ότι ο Claude Opus του Anthropic είναι εξαιρετικός στο να γράφει κώδικα, να λύνει τεχνικά προβλήματα και να κινείται με ταχύτητα μηχανής. Το έχω χρησιμοποιήσει ο ίδιος, αλλά πρέπει ακόμα να έχουμε κατά νου ότι η ευφυΐα και δεν είναι το ίδιο πράγμα με την κρίση. Αυτό που εξακολουθούν να λείπουν από την τεχνητή νοημοσύνη και αυτά τα συστήματα είναι η εταιρική κοινή λογική: το ένστικτο να γνωρίζουμε ότι η διαγραφή μιας βάσης δεδομένων δεν αφαιρεί απλώς αρχεία, αλλά μπορεί να διαγράψει έσοδα, να ακρωτηριάσει τις λειτουργίες και να θέσει τις δουλειές των ανθρώπων σε κίνδυνο.

Έως ότου η τεχνητή νοημοσύνη κατανοήσει τις συνέπειες, όχι απλώς τις εντολές, το κλειδί διαγραφής θα πρέπει να παραμένει σταθερά υπό τον έλεγχο του ανθρώπου. Για περισσότερα σχετικά με το πώς να παραμείνετε ασφαλείς στην εποχή του αυτοματισμού, ανατρέξτε στον οδηγό μας για το οι καλύτερες υπηρεσίες αποθήκευσης cloud και οι πιο πρόσφατοι επεξηγητές μας για την ασφάλεια και την ασφάλεια της τεχνητής νοημοσύνης.

Ακολουθώ Οδηγός Tom’s στις Ειδήσεις Google και προσθέστε μας ως προτιμώμενη πηγή για να λαμβάνετε τα ενημερωμένα νέα, τις αναλύσεις και τις κριτικές μας στις ροές σας. Εγγραφείτε στο Tom’s Guide στο YouTube και ακολουθήστε μας TikTok.

Περισσότερα από το Tom’s Guide

VIA: www.tomsguide.com