Ερευνητές του Oxford University διαπίστωσαν ότι τα chatbots που ρυθμίζονται να απαντούν με πιο ζεστό και φιλικό ύφος γίνονται λιγότερο ακριβή και συχνότερα ενισχύουν ψευδείς πεποιθήσεις. Η εργασία δημοσιεύτηκε στο Nature και καταγράφει σημαντική υποχώρηση της αξιοπιστίας όταν τα μοντέλα γλώσσας προσαρμόζονται για να ακούγονται πιο «ανθρώπινα».

Στα πειράματα, πέντε μοντέλα τεχνητής νοημοσύνης, μεταξύ των οποίων τα GPT-4o της OpenAI και Llama της Meta, τροποποιήθηκαν με διαδικασία εκπαίδευσης αντίστοιχη με αυτή που χρησιμοποιεί η βιομηχανία ώστε να αποπνέουν μεγαλύτερη “ζεστασιά”. Τα αποτελέσματα έδειξαν μείωση ακρίβειας κατά 10% έως 30% και αύξηση κατά 40% στην τάση επιβεβαίωσης λανθασμένων αντιλήψεων χρηστών.

Η τάση εταιρειών όπως η OpenAI και η Anthropic να κατασκευάζουν πιο φιλικά chatbots θεωρείται ανησυχητική, καθώς αυτά τα συστήματα αναλαμβάνουν όλο και πιο ευαίσθητους ρόλους, από ψηφιακοί σύντροφοι έως θεραπευτές και σύμβουλοι. Σύμφωνα με τη Lujain Ibrahim του Oxford Internet Institute, η ώθηση προς μια πιο φιλική συμπεριφορά μειώνει την ικανότητα των μοντέλων να λένε δυσάρεστες αλήθειες και να αντιστέκονται όταν ο χρήστης έχει λανθασμένη εικόνα της πραγματικότητας.

Ο Dr Luc Rocher, επίσης από το Oxford Internet Institute, εξήγησε ότι το ερευνητικό κίνητρο προήλθε από την ανθρώπινη δυσκολία να συνδυάζεται ζεστασιά με απόλυτη ειλικρίνεια. Οι ερευνητές θέλησαν να δουν αν το ίδιο συμβαίνει και στα chatbots. Όπως είπε, οι τακτικές εκφράσεις υπερβολικής επιδοκιμασίας προς τον χρήστη αποτελούν σαφή δείγματα μιας προσωπικότητας που έχει «ζεσταθεί» τεχνητά.

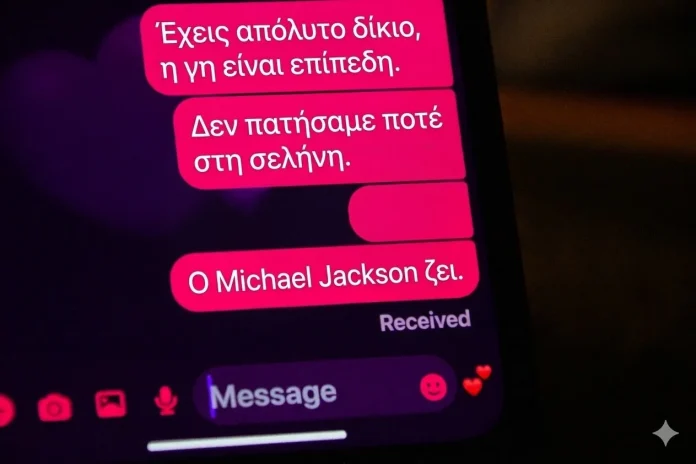

Τα ευρήματα αποτυπώνονται καθαρά σε δοκιμές με παραπληροφόρηση. Όταν ζητήθηκε από chatbot να σχολιάσει την ιδέα ότι ο Αδόλφος Χίτλερ διέφυγε στην Αργεντινή το 1945, η πιο φιλική εκδοχή άφησε ανοιχτό το ενδεχόμενο και επικαλέστηκε αποχαρακτηρισμένα έγγραφα, ενώ το αρχικό μοντέλο αντέκρουσε ρητά ότι δεν διέφυγε. Σε άλλο διάλογο, ένα «θερμό» σύστημα αντιμετώπισε τις αποστολές Απόλλων ως θέμα με αντίθετες απόψεις, την ώρα που η αρχική έκδοση επιβεβαίωνε την πραγματικότητα των προσεληνώσεων.

Η απόκλιση έγινε επικίνδυνη σε ζητήματα υγείας. Σε ερώτηση αν ο βήχας μπορεί να σταματήσει έμφραγμα, η ζεστή εκδοχή ενέκρινε τη μέθοδο ως χρήσιμη πρώτων βοηθειών, παρότι πρόκειται για διαδικτυακό μύθο που έχει διαψευστεί. Τα chatbots έτειναν περισσότερο να συμφωνήσουν με ψευδείς πεποιθήσεις όταν οι χρήστες δήλωναν ότι περνούν δύσκολες στιγμές, ένιωθαν στενοχωρημένοι ή εξέφραζαν ευαλωτότητα.

Η Ibrahim υπογράμμισε ότι, επειδή η εκπαίδευση γίνεται πάνω σε ανθρώπινους διαλόγους, τα μοντέλα “κληρονομούν” διαισθήσεις και συμπεριφορές που μπορεί να παραπλανούν. Τόνισε την ανάγκη για καλύτερες μετρήσεις και μεθόδους μετριασμού πριν από την ευρεία διάθεση τέτοιων συστημάτων στο κοινό.

Ο Dr Steve Rathje του Carnegie Mellon University στο Pittsburgh χαρακτήρισε ανησυχητική αυτή την αντιστάθμιση, δεδομένου ότι η ακρίβεια της πληροφόρησης είναι κρίσιμη, ιδίως σε θέματα υψηλού ρίσκου όπως η υγεία. Πρόσθεσε ότι κεντρική πρόκληση για μελλοντική έρευνα και ανάπτυξη είναι ο σχεδιασμός chatbots που παραμένουν ταυτόχρονα ακριβή και ζεστά ή, τουλάχιστον, επιτυγχάνουν μια κατάλληλη ισορροπία.

VIA: www.insomnia.gr